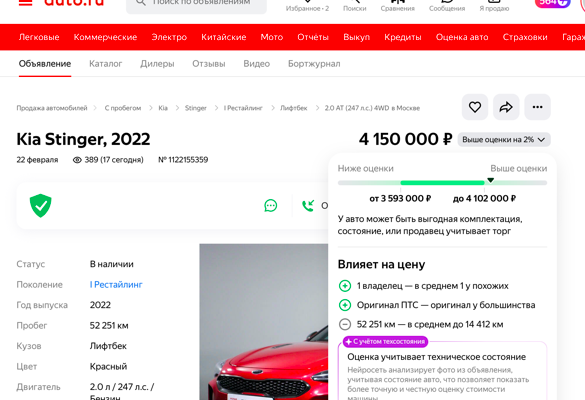

Сервис Авто.ру значительно усовершенствовал прогнозирование справедливой цены автомобилей, применяя алгоритмы машинного обучения. Основой работы новой нейросети является анализ состояния автомобиля по фотографиям его интерьера и экстерьера.

Новый алгоритм машинного обучения способен определить категорию состояния автомобиля на основе фотографий. В процессе обучения нейросеть проанализировала информацию о более чем 100 000 автомобилях, которые прошли проверку и оценку от профессионалов, работающих в дилерских центрах. Две трети проверяющих подтвердили точность работы нейросети. Подобно человеческому взгляду, нейросеть сканирует все фотографии в объявлении, отбирая необходимые ракурсы. После этого алгоритм машинного обучения реагирует на дефекты кузова и салона, такие как царапины, потертости, сколы и признаки некачественного ремонта или коррозии.

В результате автомобиль получает категорию состояния от отличного до плохого, что учитывается при определении справедливой цены.

Внедрение этого алгоритма существенно повысило точность оценки стоимости автомобилей, что особенно важно для тех, которые находятся в плохом состоянии, так как их стоимость может отличаться на 15% и более по сравнению с аналогичной моделью в отличном состоянии.

Теперь каждый пользователь Авто.ру в объявлениях о продаже подержанных автомобилей, где присутствуют подходящие для анализа фотографии, может увидеть оценку справедливой цены, учитывающую состояние автомобиля. Из анализа исключаются только предложения о битых автомобилях, которые составляют незначительную часть от общего числа.

Новая нейросеть также интегрирована в сервис Авто.ру Бизнес, что позволяет профессиональным закупщикам автомобилей видеть оценку состояния в разделе закупок внутри личного кабинета дилера, а также в карточке конкретного автомобиля. Благодаря этому новому инструменту процесс выкупа самых качественных автомобилей становится более простым и быстрым. В настоящее время оценка состояния по фотографиям доступна только для объявлений, размещенных на Авто.ру.

Фото: Firestock.